OpenAI硬件负责人离职,抗议公司仓促推进国防合作;伦理红线引发内部争议。

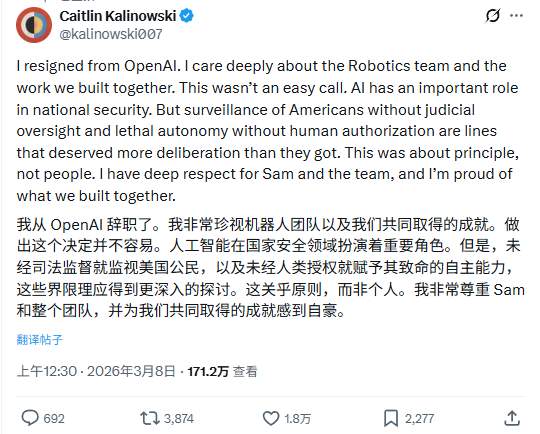

人工智能领域的快速发展,正不断触及技术与伦理的边界。最近,OpenAI公司内部出现显著动荡,其硬件与机器人工程负责人凯特琳·卡利诺夫斯基公开宣布辞职。这一决定直接源于公司与美国国防部达成的合作协议,她认为公司在安全保障措施尚未充分明确的情况下,便急于推进这一敏感合作,涉及潜在的国内监控以及致命自主武器等关键问题,缺乏足够审慎的内部讨论与评估。

卡利诺夫斯基拥有丰富的硬件开发经验。她于2024年11月加入OpenAI,此前在Meta公司担任硬件高管超过两年半,主导了代号为ProjectNazare的增强现实眼镜项目,该项目后来正式命名为Orion。在此之前,她在Meta旗下的Oculus部门工作九年多,主要专注于虚拟现实头显的研发与创新。更早时期,她曾在苹果公司任职近六年,参与了多款MacBookPro和MacBookAir等产品的设计工作。这些经历让她在硬件工程领域积累了深厚的技术积累与领导能力,也让她对AI硬件与机器人领域的伦理责任格外敏感。

此次离职事件的导火索,正是OpenAI与国防部签署的协议。该协议允许将OpenAI的人工智能模型部署到机密政府网络中,以支持国家安全相关应用。然而,在协议公布前后,竞争对手Anthropic因坚持对国内监控和自主武器的使用设置严格限制,导致与国防部的谈判破裂,随后被指定为供应链风险。这一系列事件凸显出AI企业在军事合作中的立场分歧日益明显。OpenAI的选择引发了广泛关注,也让内部员工对公司决策方向产生质疑。

协议公布后,公众反应强烈。许多用户对AI技术可能被用于敏感军事场景表示担忧,导致ChatGPT在美国市场的用户行为出现明显变化,卸载量显著上升,下载量则出现回落。这种市场反馈进一步放大了事件的舆论影响。公司首席执行官萨姆·奥尔特曼随后在社交平台上公开回应,他承认此次推进过程存在仓促之处,并承诺对协议内容进行调整,明确划定三条不可逾越的红线:人工智能不得用于国内大规模监控、涉及武力使用的自主系统必须由人类承担最终责任、同时确保服务不被用于某些特定情报机构。他强调这些议题极为复杂,需要通过清晰的沟通与缓慢的推进来逐步完善,并配合必要的技术保障措施。

OpenAI官方发言人在确认卡利诺夫斯基离职时,也发布了正式声明。公司认为与国防部的合作开辟了一条负责任地在国家安全领域应用AI的可行路径,同时明确了核心红线,包括不涉及国内监控、不支持自主武器。公司承认公众在此类问题上存在显著分歧,并承诺未来将继续与员工、政府、公民社会以及全球社区保持开放对话。这种回应显示出公司在压力之下试图平衡创新推进与伦理考量的努力,但内部人才流失与外部质疑仍将考验其长期治理能力。这一事件也提醒整个AI行业,在追求技术突破的同时,必须更加重视伦理框架的构建与公众信任的维护,以避免类似争议反复发生。